此外,在AI面前,我们都是赤裸的“工具人”,AI算法隐含的伦理问题不容忽视。首先,AI能否守护好求职者的隐私,即信息安全问题,这值得注意。如果信息保护措施不健全,那么AI有可能成为信息犯罪的凭借,盗用他人信息、侵犯他人权益。其次,算法自身也有“偏见”,亚马逊机器学习专家曾发现他们的AI面试官在筛选简历阶段,存在“重男轻女”的明显倾向。造成这一问题的原因是人工智能训练样本的问题。在开发岗位识别模型的过程中,亚马逊输入的是过去10年的简历数据库,其中大部分求职者为男性,女性相关数据太少。因此AI误以为没有特定关键词的女性简历不那么重要,从而给予了较差的推荐评价。

最后,AI面试官的算法一旦被“破译”,或者成了某种固定标准被奉为圭臬,最终尴尬的是用人单位。既然AI有固定标准和程序,那也就意味着求职者如果事先进行一番攻略,也能够按照固定套路进行练习,采用流水线式的话术、八颗牙式微笑通过筛选。随着样本的迭代,如此套路也许会成为AI面试官的经典“模板”,掉入算法陷阱,最终受困的是用人单位。

由是观之,数字化大潮下AI面试官们正跃跃欲试,亟待升级。未来,企业要想顺应潮流,仍需张开双臂拥抱AI。这既呼唤相关政策的完善,也需要算法的不断优化以拉近与人之间的距离。未来,“AI+企业+人”的美好图景我们拭目以待。

博威合金BOWAY

博威合金BOWAY 马扎克Mazak

马扎克Mazak 威尔泰克

威尔泰克 迈格泰克

迈格泰克 斯巴特

斯巴特 MAOSHENG贸盛

MAOSHENG贸盛 Miller米勒

Miller米勒 新世纪焊接

新世纪焊接 西安恒立

西安恒立 上海特焊

上海特焊 新天激光

新天激光 海目星激光

海目星激光 迅镭激光

迅镭激光 粤铭YUEMING

粤铭YUEMING 镭鸣Leiming

镭鸣Leiming 领创激光

领创激光 天琪激光

天琪激光 亚威Yawei

亚威Yawei 邦德激光bodor

邦德激光bodor 扬力YANGLI

扬力YANGLI 宏山激光

宏山激光 楚天激光

楚天激光 百超迪能NED

百超迪能NED 金运激光

金运激光 LVD

LVD Tanaka田中

Tanaka田中 BLM

BLM 易特流etal

易特流etal 百盛激光

百盛激光 Messer梅塞尔

Messer梅塞尔 PrimaPower普玛宝

PrimaPower普玛宝 Salvagnini萨瓦尼尼

Salvagnini萨瓦尼尼 奔腾激光PENTA LASER

奔腾激光PENTA LASER 华工HGTECH

华工HGTECH Bystronic百超激光

Bystronic百超激光 TRUMPF通快

TRUMPF通快 KUKA 库卡摩多机器人流水线作业

KUKA 库卡摩多机器人流水线作业 全自动焊接流水线

全自动焊接流水线 川崎工业焊接机器人 焊接管架

川崎工业焊接机器人 焊接管架 上海通用电气 全焊机系列展示

上海通用电气 全焊机系列展示 大焊 焊机匠心品质 精工之作 行家之选

大焊 焊机匠心品质 精工之作 行家之选 松下 旗下LAPRISS机器人激光焊接系统

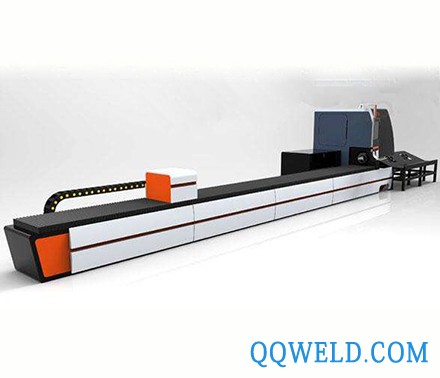

松下 旗下LAPRISS机器人激光焊接系统 创力 CANLEE光纤激光切割机

创力 CANLEE光纤激光切割机 供应逆变交直流脉冲氩弧焊机

供应逆变交直流脉冲氩弧焊机 杰伟浩**出售转让行走120吨焊接滚轮架风电塔筒滚轮架二手设备

杰伟浩**出售转让行走120吨焊接滚轮架风电塔筒滚轮架二手设备 广州市 二手库卡碳钢焊接机器人 二手机器人

广州市 二手库卡碳钢焊接机器人 二手机器人 深雅1309激光雕刻切割机 广告字有机玻璃激光切割机

深雅1309激光雕刻切割机 广告字有机玻璃激光切割机 川崎BA006N 焊接机器人 米加尼克焊机 六轴焊接机器人

川崎BA006N 焊接机器人 米加尼克焊机 六轴焊接机器人 山东激光切割机 大功率激光切割机厂家

山东激光切割机 大功率激光切割机厂家 Panasonic/松下 松下焊接机器人TA1400

Panasonic/松下 松下焊接机器人TA1400 机器人激光焊接 机器人焊接机 机器人自动化 东莞焊接

机器人激光焊接 机器人焊接机 机器人自动化 东莞焊接